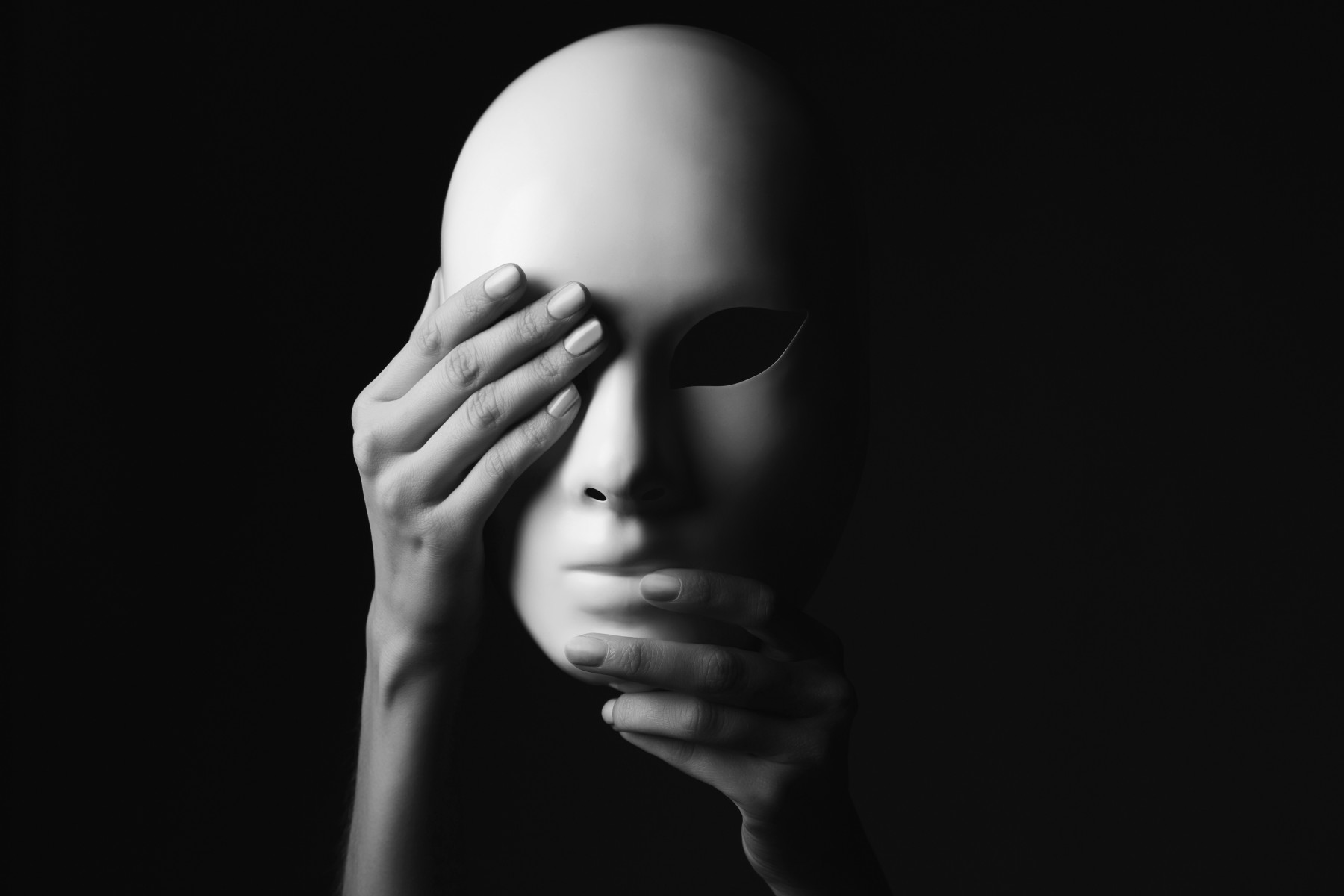

Deepfakes : La menace grandissante des vidéos manipulées par l'intelligence artificielle

Elles s’appellent Gal Gadot, Emma Watson, Selena Gomez ou encore Ariana Grande. Ce sont des actrices ou des chanteuses de renommée internationale. Leur point commun ? Elles se sont toutes retrouvées dans des vidéos pornographiques qui ont fait leur apparition sur le forum Reddit en 2017. Postées par un dénommé « DeepFakes », elles n’ont pas tardé à se répandre un peu partout sur le web, tout comme les spéculations sur leur motivation. Est-ce une nouvelle fuite de données à l’instar du précédent « Fappening » ? Ces stars nous font-elles le coup de la sextape pour générer un buzz ? Ou ces vidéos sont-elles un nouveau tournant dans leur carrière ? Rien de tout cela. Toutes ces artistes ont été victimes de Deepfakes.

L’intelligence artificielle à la manœuvre derrière les Deepfakes

Cette technologie d’intelligence artificielle (dont l’étymologie est la contraction de « deep learning » pour apprentissage profond, et « fake ») permet de « coller » le visage de ces célébrités sur le corps d’une autre personne dans des vidéos. Elle repose sur les réseaux antagonistes génératifs qui constituent des catégories d’algorithmes d’apprentissage non-supervisés. Ils sont dits antagonistes car ils sont en compétition. Un premier réseau générateur apprend à identifier des schémas dans des images ou des vidéos pour recréer, par exemple, le visage d'une personnalité. Le second réseau discriminateur essaie de déterminer si une image ou une vidéo donnée est authentique ou un faux synthétique. Ce deuxième réseau fournit ensuite un retour d'information pour renforcer la crédibilité des résultats du premier réseau.

Le Faceswapping (changement de visage d’une personne) n’est qu’une des possibilité du Deepfake. Dans une vidéo criante de vérité, l’acteur et réalisateur Jordan Peele a pu interpréter l’ancien Président américain Barack Obama et lui faire dire n’importe quoi.

Plus récemment, on a pu voir de façon un peu moins convaincante l’actuel Président Donald Trump demander à la Belgique de se retirer de l’accord de Paris sur le climat. Là encore, il s’agit d’un faux.

Vidéo : https://twitter.com/sp_a/status/998089909369016325/video/1

Les DeepFakes à l’assaut des élections ?

À l’approche des élections de mi-mandat aux États-Unis, la question est de savoir si le Deepfake pourrait être utilisé dans la campagne. Elle a été posée par Tim Hwang sur Twitter, un chercheur en intelligence artificielle qui a travaillé précédemment pour Google. Une douzaine d’experts se sont prononcés. La plupart s’accordent à dire que 2018 apparaît prématuré. La technologie n’est pas encore au point et manque d’accessibilité. 2020 leur paraît plus réaliste. C’est l’année des prochaines élections présidentielles.

Toutefois, l’enjeu dépasse ces échéances. Que se passera-t-il demain quand tout un chacun produira à la chaîne des Deepfakes à la chaîne comme c’est le cas actuellement avec les mèmes ? La menace est telle que la DARPA, l’agence américaine chargée de la recherche et développement dans le domaine militaire pour le Département de la Défense, finance un programme pour détecter automatiquement les Deepfakes.

À ce sujet, il est difficile de ne pas penser aux élections présidentielles américaines de 2016 et aux perturbations à la vie démocratique que pourraient causer un État étranger armé de cet outil. C’est pourquoi certains experts comme Michael Horowitz, Professeur de Sciences politiques à l’Université de Pennsylvanie, n’excluent pas une ingérence russe pendant la campagne des élections de mi-mandat. Objectif : renforcer les biais des électeurs dans le but de cliver encore plus la société américaine.

Une sombre perspective sur laquelle les chercheurs et les sociétés planchent pour trouver des contre-mesures. Récemment, Facebook a déclaré renforcer ses moyens dans sa lutte contre les fake news. La société de Menlo Park souhaite notamment renforcer son dispositif de fact-checking de vidéos qui pourrait s’appliquer aux Deepfakes, même si l’hypothèse n’est pas mentionnée.

Au final, si les experts estiment qu’un scandale politique lié aux Deepfakes n’est qu’une question de temps, il n’est pas impossible que le scandale arrive là où personne ne l’attend. Ce qui ne serait pas une surprise de la part d’une technologie qui a émergé sur la scène médiatique grâce à la pornographie.

Article de Thierry Randretsa